Während klassische SEO-Tools oft im Dunkeln tappen, wer oder was die eigenen Server-Kapazitäten beansprucht, ermöglicht Cloudflare AI Crawl Control heute eine präzise Identifikation und Steuerung von KI-Agenten wie ChatGPT oder Anthropic in Echtzeit.

Diese operative Verschiebung bedeutet, dass Webmaster nicht mehr nur passiv auf Crawler reagieren, sondern den Zugriff auf ihre wertvollen Datenbestände aktiv regeln können, um einer unkontrollierten Extraktion durch Large Language Models (LLMs) vorzubeugen.

Wer seine technische Infrastruktur heute nicht anpasst, riskiert nicht nur hohe Serverlasten, sondern auch den Verlust der Kontrolle über das eigene geistige Eigentum in einer Ära, in der Dienste wie Perplexity herkömmliche Suchanfragen zunehmend ersetzen.

Relevante Tools auf Utildesk

Wenn du das Thema nicht nur einordnen, sondern praktisch vergleichen willst, sind diese Werkzeuge und Frameworks ein guter Startpunkt:

- Claude - wenn du agentische Coding-Sessions im Terminal oder in der IDE praktisch gegen den Alltag prüfen willst.

- GitHub Copilot - als Referenz für den produktiven Copilot-Layer direkt im Editor.

- Cursor - wenn du einen stärker agentischen IDE-Workflow mit eigenem Arbeitskontext vergleichen willst.

- Aider - falls du Git-nahe Coding-Sessions lieber direkt im Terminal steuerst.

- LangChain - wenn du die Orchestrierungslogik und den Framework-Layer hinter Agenten verstehen willst.

- CrewAI - wenn dich kollaborative Multi-Agent-Flows mit Guardrails und Observability interessieren.

KI-Traffic analysieren: Transparenz durch Cloudflare AI Crawl Control

Der erste Schritt zu einer zukunftssicheren Website besteht darin, die Identität und das Verhalten der Besucher genau zu verstehen. Herkömmliche Analytics-Systeme scheitern oft daran, zwischen menschlichen Nutzern, nützlichen Such-Bots und aggressiven KI-Crawlern zu differenzieren.

Mit modernen Lösungen wie AI Crawl Control gewinnen Betreiber eine detaillierte Sichtbarkeit in die spezifischen Anfragemuster von KI-Diensten.

Über zentrale Dashboards lässt sich exakt überwachen, welche KI-Modelle auf welche Verzeichnisse zugreifen. Dies ist besonders für Publisher, E-Commerce-Plattformen und Betreiber von Dokumentations-Seiten kritisch, um den Nutzen eines Crawls gegen die verbrauchten Ressourcen abzuwägen.

Nur mit dieser Transparenz können fundierte Entscheidungen getroffen werden, ob ein Zugriff von OpenAI oder Anthropic den Unternehmenszielen dient oder lediglich Kosten verursacht.

Die Analyse des Traffics erlaubt es zudem, Verhaltensmuster zu bewerten und zu erkennen, welche Inhalte für KI-Systeme besonders attraktiv sind. Diese Erkenntnisse bilden die Grundlage für eine differenzierte Content-Strategie, die sowohl die Sichtbarkeit in KI-generierten Antworten erhöht als auch den Schutz sensibler Daten sicherstellt.

Letztlich geht es darum, die Souveränität über den Datenfluss zurückzugewinnen, die durch die schiere Masse automatisierter Anfragen oft gefährdet ist.

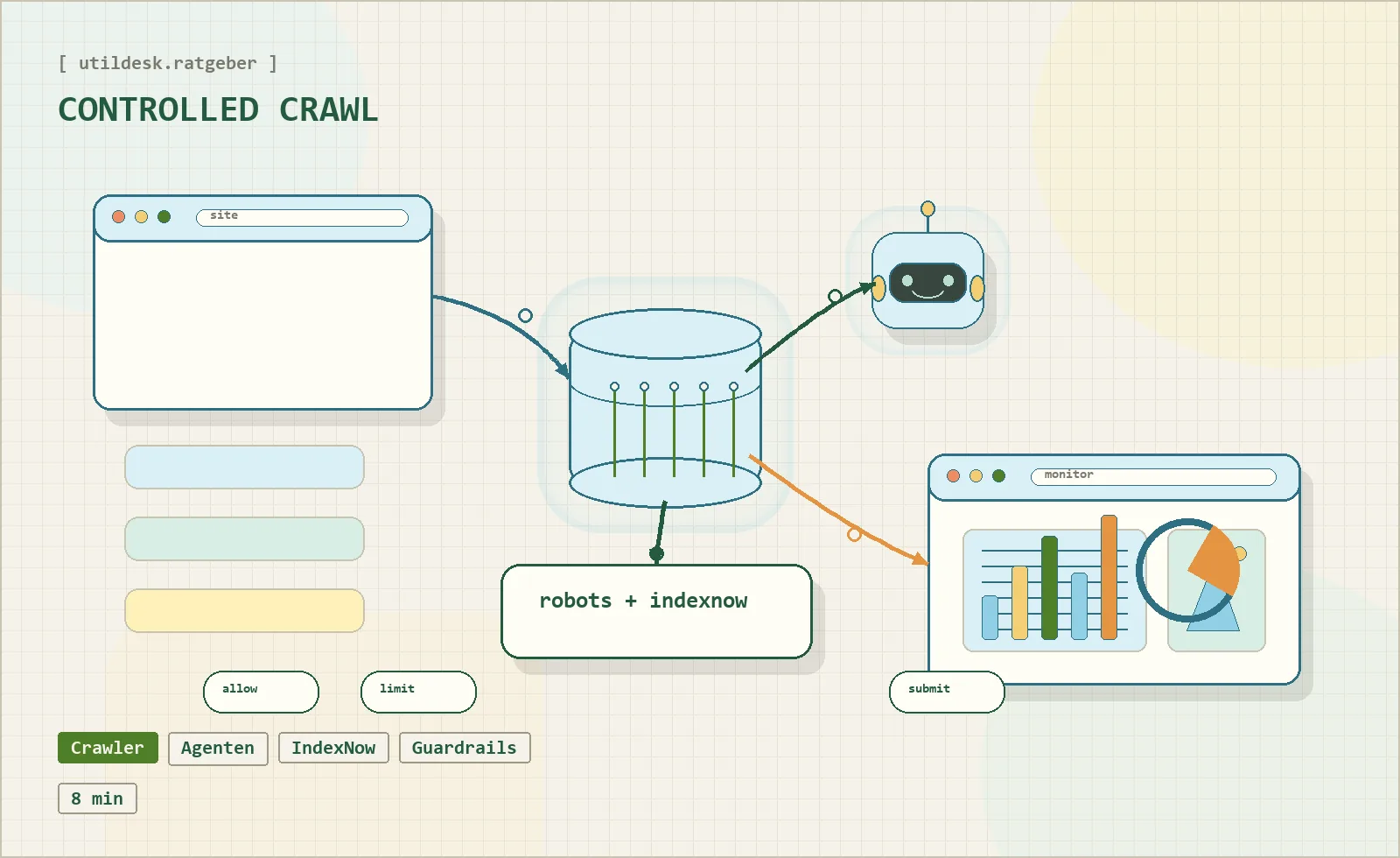

Technische Beschleunigung: Crawler Hints und das IndexNow-Protokoll

Klassisches Web-Crawling ist ein oft ineffizienter Prozess, bei dem Bots das Internet durchwandern und förmlich raten müssen, wann Inhalte aktualisiert wurden. Dies führt entweder zu veralteten Informationen in den KI-Antworten oder zu einer unnötigen Serverlast durch ständige Scans unveränderter Seiten.

Um eine Website "agent-ready" zu machen, muss die Kommunikation zwischen dem Server und den Crawlern von Anbietern wie Google proaktiver werden.

Hier setzen Crawler Hints an, die als aktives Signal der Infrastruktur dienen. Anstatt darauf zu warten, dass ein Bot zufällig vorbeikommt, sendet Cloudflare aktiv Hinweise an Suchmaschinen und KI-Dienste, sobald sich Inhalte tatsächlich geändert haben.

Ein zentraler Mechanismus ist dabei die Integration von IndexNow, einem Protokoll, das Dienste sofort über die Erstellung oder Löschung von Content informiert.

Crawler Hints nutzen den Cache-Status MISS als Signal für eine notwendige Aktualisierung und leiten Crawler gezielt zur neuen Version. Dies verbessert nicht nur die Aktualität der Daten für KI-generierte Antworten erheblich, sondern schont auch die Ressourcen des Ursprungsservers und reduziert die Umweltbelastung.

Für den Betreiber bedeutet dies eine effizientere Indexierung bei gleichzeitig sinkenden Betriebskosten für die IT-Infrastruktur.

Risikomanagement und Guardrails: Schutz vor Datenextraktion

Nicht jeder KI-Agent agiert im Interesse des Website-Betreibers, weshalb granulare Guardrails für eine moderne Website unverzichtbar sind. Besonders im E-Commerce müssen sensible Informationen wie Lagerbestände oder dynamische Preisgestaltungen vor massenhafter Extraktion geschützt werden, um Wettbewerbsnachteile zu verhindern.

Einfache Blockaden von IP-Adressen reichen hierfür oft nicht mehr aus.

Praktisch lassen sich Schutzmaßnahmen durch spezifische Richtlinien in der Cloudflare WAF (Web Application Firewall) oder direkt in den AI-Crawl-Control-Einstellungen umsetzen. Betreiber können individuelle Regeln für einzelne Crawler festlegen, die von vollständiger Erlaubnis für Partner bis zum strikten Blockieren von Bots reichen, die die robots.txt ignorieren.

Das kontinuierliche Monitoring der robots.txt-Compliance ist dabei ein wesentlicher Bestandteil, um bösartige Bots frühzeitig zu identifizieren.

Ein innovativer Ansatz zur Steuerung ist die Monetarisierung des Zugriffs über Modelle wie Pay Per Crawl, das sich aktuell in der Beta-Phase befindet. In diesem Szenario können Website-Besitzer Preise für den Zugriff durch KI-Crawler festlegen und den Datenfluss als wirtschaftliche Ressource betrachten.

Solche Mechanismen stellen sicher, dass die Offenheit des Webs nicht zur unbezahlten Ausbeutung wertvoller Inhalte führt.

Zukunftsfähige Datenformate: Markdown und strukturierte Daten

KI-Agenten bevorzugen bei der Datenaufnahme maximale Effizienz und Klarheit. Während Menschen ansprechendes Design schätzen, empfinden LLMs komplexen HTML-Code oft als unnötige Verschwendung von Kontext-Fenstern.

Die Bereitstellung von Inhalten im Markdown-Format bietet hier einen entscheidenden Vorteil, da es für KI-Systeme wesentlich präziser zu verarbeiten ist als verschachtelter Code.

Neben dem Format bleibt die Bedeutung von strukturierten Daten nach dem Standard von Google Search Central bestehen. Durch die Verwendung von maschinenlesbaren Auszeichnungen (Structured Data), idealerweise im JSON-LD Format, helfen Betreiber den Agenten, den Kontext von Informationen wie Preisen oder Autoren sofort korrekt einzuordnen.

Google empfiehlt JSON-LD ausdrücklich, da es einfach zu implementieren ist und nicht mit dem sichtbaren Text verschachtelt werden muss.

Studien belegen den massiven Effekt dieser technischen Optimierung: Rotten Tomatoes konnte durch strukturierte Daten eine um 25 % höhere Klickrate erzielen, während Nestlé sogar eine Steigerung von 82 % bei Rich-Suchergebnissen maß. Wer diese technische Basis mit einer klaren Steuerung kombiniert, stellt sicher, dass die eigene Website korrekt und im Sinne des Urhebers interpretiert wird.

Eine Investition in die Maschinenlesbarkeit ist somit heute ebenso wichtig wie die Optimierung der Nutzererfahrung für Menschen.

Fazit

Die Vorbereitung einer Website auf KI-Agenten ist kein einmaliges technisches Update, sondern eine grundlegende strategische Neuausrichtung. Es gilt, die Balance zwischen maximaler Sichtbarkeit in KI-Antworten und dem Schutz des geistigen Eigentums zu wahren.

Wer diesen Wandel ignoriert, riskiert, in den Antworten moderner Agenten unsichtbar zu werden oder die Kontrolle über seine wertvollsten Datenressourcen zu verlieren.

Durch den Einsatz von Analysetools wie AI Crawl Control und modernen Protokollen wie IndexNow gewinnen Betreiber ihre Datensouveränität zurück. Dies optimiert nicht nur die Serverlast, sondern stellt auch sicher, dass Inhalte in der nächsten Generation des Webs eine zentrale Rolle spielen.

Langfristig wird die Maschinenlesbarkeit zu einem entscheidenden Faktor für den digitalen Erfolg und die Wettbewerbsfähigkeit.

Nächste Schritte

Um deine Website erfolgreich für KI-Agenten zu rüsten, empfiehlt sich ein strukturierter Prozess, der Analyse und technische Anpassung vereint. Beginne sofort mit einer Bestandsaufnahme deines aktuellen Bot-Traffics, um die Last und Herkunft der Anfragen genau zu bewerten.

- Traffic-Analyse aktivieren: Nutze das Cloudflare-Dashboard, um die Aktivitäten von KI-Services zu überwachen und festzustellen, welche Modelle wie oft auf deine Inhalte zugreifen.

- Crawler-Steuerung konfigurieren: Aktualisiere deine robots.txt und ergänze sie um spezifische Anweisungen für KI-Crawler, um sensible Bereiche gezielt zu schützen.

- Technische Signale automatisieren: Aktiviere Crawler Hints in den CDN-Einstellungen, um die Kommunikation mit Diensten wie Google via IndexNow zu automatisieren.

- Präzision durch Struktur: Implementiere strukturierte Daten nach aktuellen Standards (JSON-LD) und prüfe die Bereitstellung von Inhalten im Markdown-Format.

- Schutzmaßnahmen etablieren: Setze granulare Zugriffsregeln über eine WAF um, um Preislisten oder Bestände vor unbefugtem Massen-Scraping zu sichern.

- Indexing-Kontrolle verfeinern: Nutze Meta-Tags oder das X-Robots-Tag: noindex, um die Indexierung spezifischer sensibler Seiten durch KI-Agenten gezielt zu unterbinden.