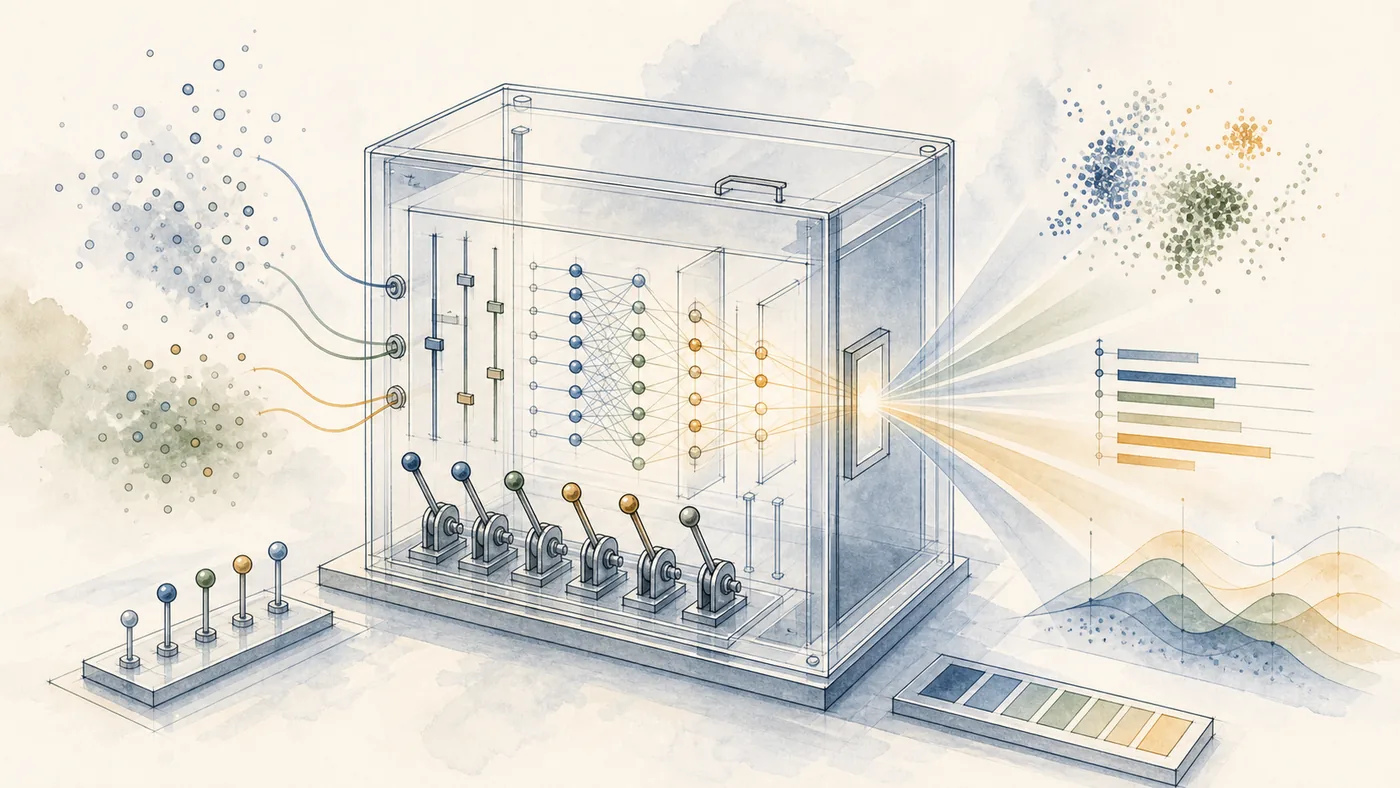

InterpretML ist ein Open-Source-Werkzeug für interpretierbares Machine Learning. Es hilft, Modelle, Vorhersagen und Feature-Einflüsse nachvollziehbarer zu machen.

Das Tool ist besonders relevant, wenn ein Modell nicht nur funktionieren, sondern erklärbar, prüfbar und dokumentierbar sein muss.

Für wen ist das Tool geeignet?

InterpretML passt zu Data Scientists, ML Engineers, Risk-Teams und Organisationen, die Modelle erklären und prüfen müssen. Besonders relevant ist es, wenn Vorhersagen nicht nur gut funktionieren, sondern gegenüber Fachbereich, Audit, Compliance oder Kunden nachvollziehbar sein sollen.

Weniger passend ist InterpretML für reine Dashboard-Nutzer oder Teams ohne eigenen Modellierungsprozess. Es setzt voraus, dass Daten, Modell, Metriken und Fragestellung verstanden werden.

Typische Einsatzszenarien

- Modell-Erklärbarkeit: globale und lokale Einflüsse auf Vorhersagen sichtbar machen.

- Risikoprüfung: unerwartete Features, Bias-Hinweise oder instabile Muster untersuchen.

- Modellvergleich: Black-Box-Modelle gegen erklärbarere Alternativen abwägen.

- Stakeholder-Kommunikation: Ergebnisse für Fachbereiche verständlicher aufbereiten.

- Audit-Vorbereitung: Erklärungen, Annahmen und Grenzen von Modellen dokumentieren.

Hauptfunktionen

- Werkzeuge für globale und lokale Modellinterpretation

- Unterstützung für Explainable Boosting Machines und Erklärmethoden

- Python-naher Einsatz in Data-Science-Workflows

- Open-Source-Basis für nachvollziehbare Modellanalyse

Vorteile und Grenzen

Vorteile

- Stark für Modellverständnis und Erklärbarkeit

- Gut kombinierbar mit bestehenden Python-Workflows

- Open Source und damit gut prüfbar

Grenzen

- Ersetzt keine saubere Daten- und Modellgovernance

- Erklärungen müssen fachlich interpretiert werden

- Nicht für Nicht-Techniker als Standalone-App gedacht

Workflow-Fit

InterpretML sollte nach dem ersten Modelltraining, aber vor produktiver Freigabe eingesetzt werden. Ein guter Ablauf ist: Zielmetrik prüfen, Datenqualität analysieren, Erklärungen erzeugen, auffällige Features untersuchen und die Erkenntnisse mit Fachexperten besprechen.

Das Tool ersetzt keine Modellvalidierung. Es macht Muster sichtbarer, aber Teams müssen selbst entscheiden, ob ein Muster fachlich plausibel, ethisch akzeptabel und stabil genug für den Einsatz ist.

Datenschutz & Daten

InterpretML läuft typischerweise in der eigenen Python-Umgebung. Trotzdem müssen Trainingsdaten, Reports und exportierte Erklärungen wie sensible Analyseartefakte behandelt werden.

Preise & Kosten

InterpretML ist Open Source. Kosten entstehen eher durch Infrastruktur, Data-Science-Zeit und Governance-Aufwand.

Redaktionelle Einschätzung

InterpretML ist ein Werkzeug für Teams, die Modelle nicht nur bauen, sondern erklären müssen. Es wird besonders wertvoll, wenn Entscheidungen auditierbar sein sollen; wer nur ein schönes Dashboard sucht, wird den Nutzen unterschätzen.

👉 Zum Anbieter: https://interpret.ml/

FAQ

Ist InterpretML nur für regulierte Branchen relevant?

Nein. Regulierte Branchen profitieren besonders, aber auch Produkt-, Marketing- oder Operations-Modelle werden besser, wenn Teams verstehen, warum sie bestimmte Vorhersagen treffen.

Braucht man ML-Kenntnisse?

Ja. InterpretML ist kein Einsteiger-Dashboard, sondern ein Werkzeug für Menschen, die Daten, Modelle und Bewertungsmetriken einordnen können.

Kann InterpretML Bias verhindern?

Nicht automatisch. Es kann Hinweise liefern und Muster sichtbar machen, aber Bias-Prüfung braucht Datenverständnis, fachliche Bewertung und klare Entscheidungsregeln.