Nicht das einzelne Prompt ist inzwischen der Engpass, sondern die Koordination vieler paralleler KI-Schritte. Sobald Teams mehr als einen Coding-Assistenten einsetzen, tauchen dieselben Fragen auf: Welche Spezifikation gilt gerade? Welche Teilaufgabe liegt noch bei welchem Agenten? Was ist schon geprüft, und was ist nur schnell erzeugter Output? Genau aus diesem organisatorischen Druck entsteht gerade eine neue Schicht im Stack: KI-Orchestrierung.

Der Flaschenhals verschiebt sich vom Schreiben zur Steuerung

GitHub Copilot, Cursor, Aider und Claude zeigen bereits heute, wie stark der einzelne Coding-Assistent geworden ist. Sie können Code vorschlagen, Dateien ändern, Tests anstoßen und in manchen Fällen sogar komplette Aufgabenpakete abarbeiten. Das eigentliche Problem beginnt aber eine Ebene darüber: Sobald mehrere Agenten, Branches, Reviews und Sitzungen parallel laufen, reicht ein guter Chat nicht mehr aus.

An diesem Punkt verschiebt sich die Herausforderung. Teams kämpfen dann nicht mehr primär mit fehlender Generierungsgeschwindigkeit, sondern mit fehlender Ordnung. Wer arbeitet gerade an welcher Teilaufgabe? Wo wird gegen die Spezifikation geprüft? Welche Änderung ist wirklich mergefähig? Aus Sicht produktiver Entwicklung ist genau das der Moment, in dem aus "KI hilft beim Coding" eine neue Workflow-Frage wird.

Was eine Orchestrierungsschicht konkret leistet

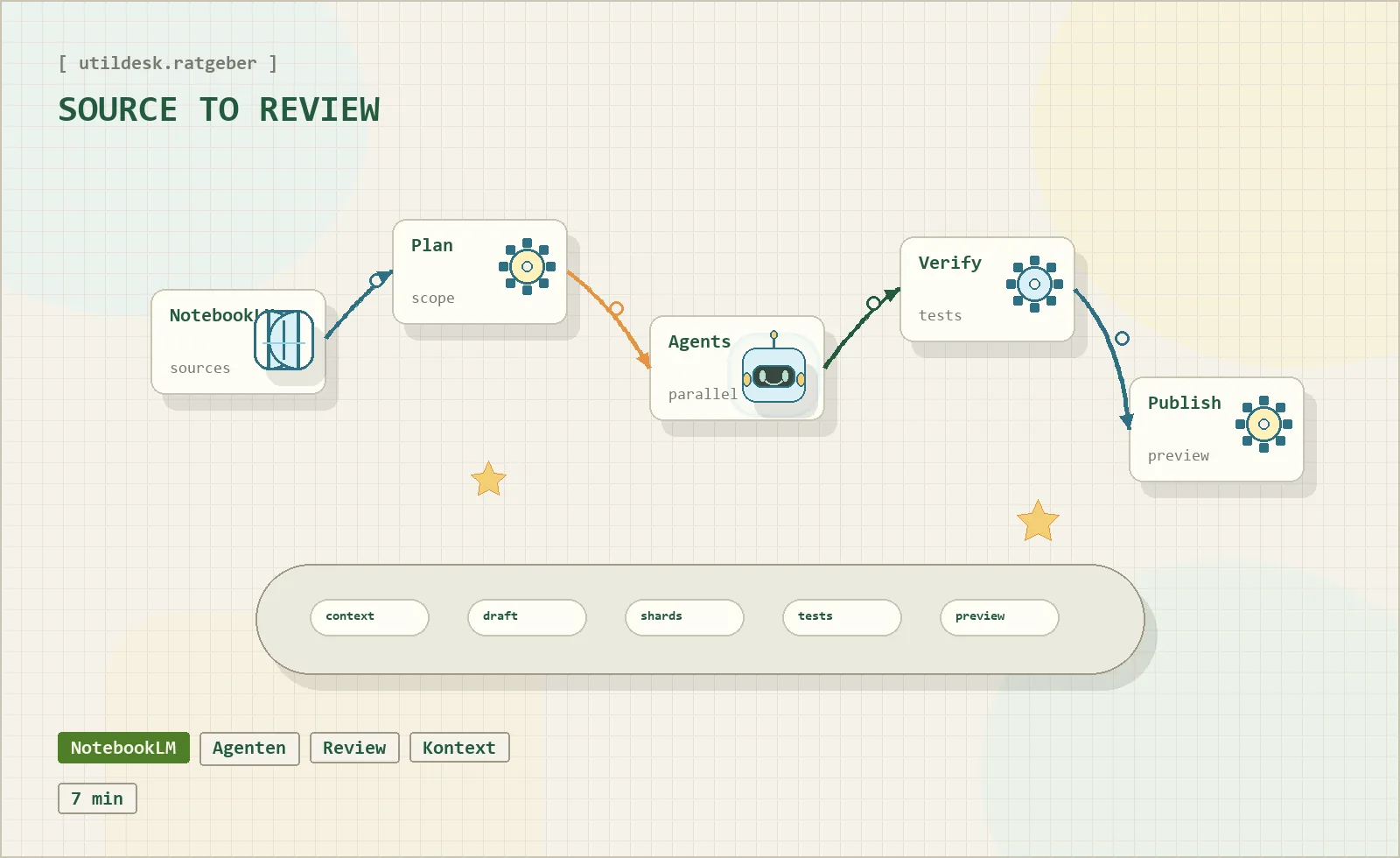

Eine echte Orchestrierungsschicht ersetzt den Entwickler nicht, sondern strukturiert die Arbeit mehrerer Agenten rund um ein gemeinsames Ziel. In der Praxis gehören dazu heute vor allem vier Bausteine:

- eine lebendige Spezifikation, auf die sich nicht nur Menschen, sondern auch Agenten beziehen,

- ein Planungs- oder Koordinationsschritt, der Aufgaben in sinnvolle Teilpakete zerlegt,

- getrennte Arbeitskontexte, damit parallele Änderungen sich nicht gegenseitig überfahren,

- eine Prüf- und Review-Schleife, bevor aus generiertem Code ein echter Pull Request wird.

Genau deshalb ist Git plötzlich wieder ein strategischer Teil der KI-Diskussion. Offizielle Git-Dokumentation zu git worktree wirkt auf den ersten Blick nicht besonders glamourös, ist aber für agentische Entwicklung hochrelevant: Parallele Arbeitsbäume erlauben es, mehrere Aufgaben in einem Repository sauber voneinander zu trennen, statt alles in einem chaotischen Haupt-Branch zu vermischen. Was früher eher ein fortgeschrittener Git-Trick war, wird im agentischen Workflow zur Grundvoraussetzung.

Auf Framework-Seite passiert etwas Ähnliches. LangChain und CrewAI stehen nicht für "noch einen Chatbot", sondern für den Versuch, Agenten, Zustandslogik, Werkzeuge und Guardrails systematisch zusammenzuführen. Der Markt sucht damit nicht nach einer hübscheren Oberfläche, sondern nach einem belastbaren Betriebsmodell für verteilte KI-Arbeit.

Warum Verifikation wichtiger wird als noch ein weiterer Assistent

Je mehr KI-generierte Änderungen gleichzeitig entstehen, desto weniger hilft klassische Sichtprüfung im Nachgang. Genau dort setzen neuere Orchestrierungsansätze wie Intent an: Nicht erst der Pull Request soll die Wahrheit über Qualität liefern, sondern schon die vorgelagerte Kombination aus Spezifikation, Aufgabenzerlegung und Verifikation.

Das ist mehr als ein Detail. Wenn ein Agent an mehreren Dateien oder sogar serviceschneidend arbeitet, kann ein formal "sauberer" Diff trotzdem am eigentlichen Ziel vorbeigehen. Tests, Linter und ein freundlicher Review-Text reichen dann nicht immer. Entscheidend wird, ob das System vor dem Merge überhaupt gegen eine tragfähige Erwartung prüft. Genau dort trennt sich derzeit Marketing von echter Infrastruktur.

Für Teams heißt das: Ein guter Orchestrierungs-Workflow wird nicht daran erkennbar, dass er möglichst viel automatisch tut. Er wird daran erkennbar, dass er den menschlichen Review entlastet, ohne Verantwortung und Eingriffspunkte unsichtbar zu machen.

Sichtbarkeit wird selbst zum Produktmerkmal

Mit mehr Agenten steigt nicht nur der Bedarf an Planung, sondern auch an Nachvollziehbarkeit. Wer agentische Entwicklung ernsthaft nutzt, braucht früher oder später Antworten auf sehr operative Fragen: Welche Sitzung ist noch offen? Welche Entscheidung wurde in welcher Session getroffen? Wo kann ich in eine längere Bearbeitung wieder einsteigen, ohne mir den Kontext neu zusammenzusuchen?

Genau deshalb ist ein Werkzeug wie Jeeves interessant. Der Punkt ist nicht, dass es noch eine weitere TUI gibt. Spannend ist, dass Session-Verwaltung, Verlauf und Wiederaufnahme plötzlich als eigenständige Produktaufgabe sichtbar werden. Dasselbe sieht man auch in den offiziellen Unterlagen zu Claude Code: mehrere Sessions, wiederkehrende Aufgaben, Automatisierung und Kontextpflege sind dort nicht Randnotizen, sondern Teil der Kernlogik.

Der Markt lernt gerade, dass agentische Produktivität nicht nur aus Generierung besteht. Sie hängt daran, wie gut ein Team Verlauf, Zwischenstände, offene Fragen und Eingriffe über längere Arbeitsläufe kontrollieren kann.

Relevante Tools auf Utildesk

Wenn du das Thema nicht abstrakt, sondern entlang realer Produktkategorien bewerten willst, lohnt sich ein Blick auf diese Werkzeuge:

- Claude als Referenz für agentische Coding-Sessions und längere Arbeitskontexte,

- GitHub Copilot für den produktiven Copilot-Layer direkt im Editor,

- Cursor für einen stärker agentischen IDE-Workflow,

- Aider für Git-nahe Coding-Sessions im Terminal,

- LangChain für den Framework-Layer hinter orchestrierten Agenten,

- CrewAI für kollaborative Multi-Agent-Flows mit Rollen, Guardrails und Observability.

Gerade diese Mischung ist aufschlussreich: Ein Teil des Marktes optimiert den eigentlichen Coding-Moment, der andere Teil organisiert den Ablauf darum herum. Erst zusammen ergibt sich das Bild einer neuen Workflow-Ebene.

Woran Teams gute Orchestrierung erkennen

Wenn du Orchestrierungsprodukte oder agentische Frameworks evaluierst, helfen fünf einfache Fragen:

- Gibt es eine belastbare Spezifikation? Ohne klaren Zielzustand wird aus Automatisierung schnell nur schnellere Unordnung.

- Arbeiten Aufgaben in getrennten Kontexten? Parallele Agenten brauchen saubere Arbeitsräume, sonst explodiert der Merge-Aufwand.

- Ist Verifikation vor dem PR möglich? Je später Fehler sichtbar werden, desto geringer ist der eigentliche Automatisierungsgewinn.

- Bleiben Sitzungen nachvollziehbar? Verlauf, Wiederaufnahme und Statussicht sind kein Luxus, sondern Betriebsnotwendigkeit.

- Lassen sich Modelle und Tools real integrieren? Ein guter Orchestrierungs-Layer muss in Git, Reviews, Terminal-Workflows und Teamprozesse passen.

Wer diese Punkte ignoriert, bekommt vielleicht eine eindrucksvolle Demo, aber noch kein belastbares Produktionssystem.

Was das für den Markt bedeutet

Der Begriff "KI-Agent" wird inzwischen für sehr unterschiedliche Dinge verwendet: für bessere Autocomplete-Helfer, für terminalnahe Coding-Assistenten, für Frameworks mit Zustand und Guardrails und für komplette Arbeitsräume mit Planungs- und Verifikationslogik. Genau deshalb ist Orchestrierung gerade ein so spannendes Thema. Sie zwingt den Markt, diese Ebenen sauberer zu unterscheiden.

Der wahre Fortschritt liegt also nicht darin, dass ein einzelner Agent noch mehr schreiben kann. Er liegt darin, dass Teams lernen, viele agentische Schritte sicher, nachvollziehbar und reviewfähig in ihren echten Entwicklungsprozess einzubauen. Wer diese Schicht beherrscht, gewinnt nicht nur Tempo, sondern vor allem Ordnung.

Fazit

KI-Orchestrierung ist kein dekorativer Aufsatz auf bestehende Coding-Tools. Sie wird zur Betriebsschicht für Teams, die mehrere Agenten, Sessions, Reviews und Spezifikationen gleichzeitig kontrollieren müssen. Genau deshalb lohnt es sich, das Thema nicht als Trendwort abzutun: Hier entsteht gerade die Infrastruktur, die aus agentischem Output vernünftige Softwarearbeit macht.