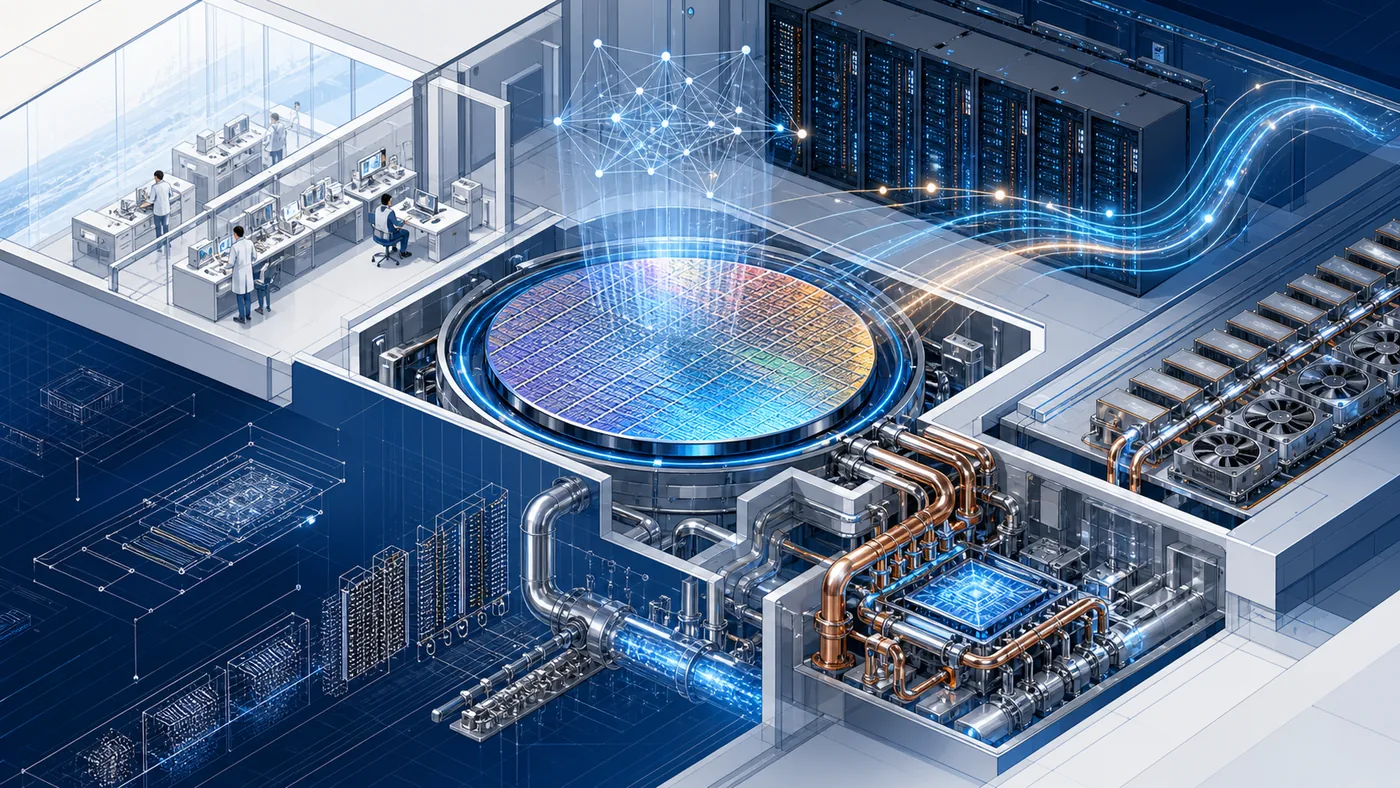

Intel Habana Labs steht für Intels Gaudi-KI-Beschleuniger und den zugehörigen Software-Stack für Training und Inferenz großer Modelle.

Das ist kein SaaS-Tool für einzelne Nutzer, sondern Infrastruktur für Teams, die KI-Workloads auf spezialisierter Hardware betreiben oder Kosten und Verfügbarkeit gegen GPU-Alternativen abwägen.

Für wen ist das Tool geeignet?

Intel Habana Labs richtet sich nicht an normale Endanwender, sondern an Teams, die KI-Infrastruktur planen: ML-Plattformteams, Cloud-Architekten, Forschungsgruppen und Unternehmen mit hohen Trainings- oder Inferenzkosten. Relevant ist es, wenn Beschleunigerhardware, Kosten pro Modelllauf und Lieferketten eine strategische Rolle spielen.

Für einzelne KI-Apps, Chatbots oder No-Code-Workflows ist das Thema zu tief im Stack. Dort sind fertige APIs, Cloud-Modelle oder MLOps-Plattformen näher am Alltag.

Typische Einsatzszenarien

- KI-Infrastruktur bewerten: Alternativen zu GPU-zentrierten Trainings- und Inferenzumgebungen prüfen.

- Kosten- und Kapazitätsplanung: Hardwareoptionen mit Workload, Modellgröße und Betriebsmodell abgleichen.

- Enterprise-ML-Plattformen: Beschleuniger in größere Cloud- oder Rechenzentrumsstrategien einordnen.

- Forschung und Benchmarking: Modellleistung, Framework-Unterstützung und Portierungsaufwand vergleichen.

- Vendor-Strategie: Abhängigkeiten von einzelnen Hardware- oder Cloud-Anbietern reduzieren.

Hauptfunktionen

- Gaudi-Beschleuniger für Training und Inferenz

- Software-Stack für gängige ML-Frameworks

- Fokus auf skalierbare KI-Infrastruktur

- Enterprise- und Cloud-nahe Einsatzszenarien

Vorteile und Grenzen

Vorteile

- Interessante Alternative zu GPU-zentrierten KI-Stacks

- Relevant für Kosten-, Lieferketten- und Skalierungsfragen

- Nahe an professionellen Trainings- und Inferenzworkloads

Grenzen

- Nichts für typische Endnutzer oder leichte SaaS-Workflows

- Migration erfordert technische Prüfung und Benchmarking

- Ökosystem und Verfügbarkeit müssen konkret bewertet werden

Workflow-Fit

Intel Habana Labs gehört in eine Architektur- und Beschaffungsentscheidung, nicht in einen spontanen Tooltest. Ein sinnvoller Prozess beginnt mit konkreten Workloads: Modelltypen, Batchgrößen, Latenzanforderungen, Frameworks, Datenpipeline und Betriebsumgebung. Erst danach lohnt sich ein Benchmark.

Entscheidend ist der Gesamtaufwand: Portierung, Treiber, Toolchain, Monitoring, Team-Know-how und Support müssen gegen reine Hardwarekosten gerechnet werden. Ohne diesen Blick kann ein vermeintlich günstiger Beschleuniger im Betrieb teuer werden.

Datenschutz & Daten

Bei eigener Infrastruktur liegen Datenschutz und Modellgovernance stärker beim Betreiber. Gerade deshalb müssen Datenflüsse, Modellartefakte, Logs und Zugriffe sauber dokumentiert werden.

Preise & Kosten

Preise hängen von Hardware, Cloud-Angebot, Beschaffung und Support ab. Für realistische Entscheidungen braucht es Benchmarks mit eigenen Workloads statt nur Listenpreise.

Redaktionelle Einschätzung

Intel Habana Labs ist für die meisten Anwender kein klassisches Tool, sondern ein Infrastrukturthema. Relevant wird es, wenn KI-Training, Inferenzkosten, Hardwareverfügbarkeit und Cloud-Abhängigkeit strategisch wichtig sind; für einzelne App-Workflows bleibt es zu tief im Stack.

👉 Zum Anbieter: https://habana.ai/

FAQ

Ist Intel Habana Labs ein Tool für Anwender?

Nein, eher ein Infrastruktur- und Hardwarethema. Es betrifft Teams, die KI-Training oder Inferenz auf eigener oder spezialisierter Infrastruktur planen.

Wann wird Habana relevant?

Wenn GPU-Kosten, Verfügbarkeit, Skalierung oder Vendor-Abhängigkeit zu echten Engpässen werden und ein Team die technische Tiefe für Benchmarks hat.

Was sollte man vor einer Entscheidung prüfen?

Framework-Kompatibilität, Modellunterstützung, Betriebsaufwand, Support, Benchmarks mit eigenen Workloads und Integration in bestehende MLOps-Prozesse.