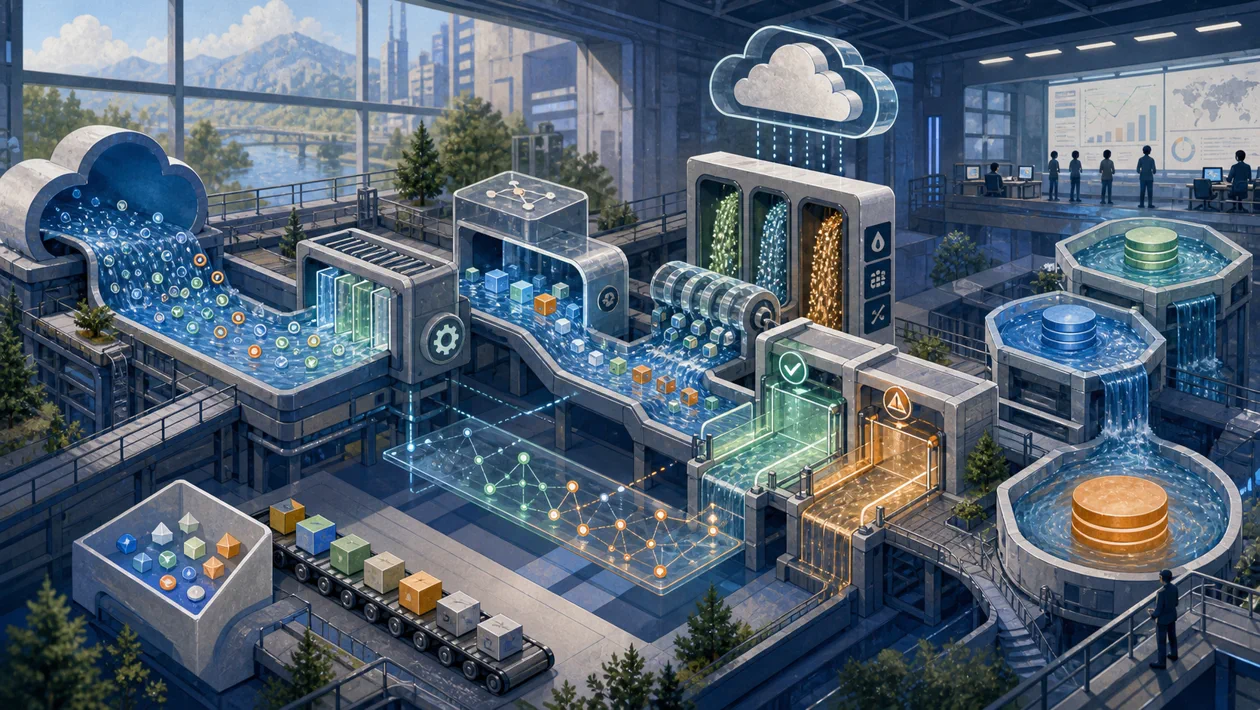

Google Cloud Dataflow ist ein vollständig verwalteter Dienst zur Datenverarbeitung und -analyse in Echtzeit. Er ermöglicht das Entwickeln und Ausführen von Pipelines für Batch- und Streaming-Daten mit hoher Skalierbarkeit und Zuverlässigkeit. Die Plattform basiert auf Apache Beam und bietet nahtlose Integration in das Google Cloud-Ökosystem.

Für wen ist Google Cloud Dataflow geeignet?

Google Cloud Dataflow richtet sich an Unternehmen und Entwickler, die große Datenmengen effizient verarbeiten und analysieren möchten, ohne sich um die Infrastruktur kümmern zu müssen. Besonders relevant ist der Dienst für Data Engineers, Datenwissenschaftler und IT-Teams, die Echtzeit-Streaming-Daten und Batch-Verarbeitung kombinieren wollen. Ideal für Branchen wie Finanzen, Telekommunikation, E-Commerce und IoT, die schnelle, skalierbare und zuverlässige Datenpipelines benötigen.

Google Cloud Dataflow ist besonders nützlich für Data-, Analytics-, Research- und Engineering-Teams, die Entscheidungen reproduzierbar machen müssen. Der Nutzen sollte an einem realen Prozess gemessen werden, in dem Datenqualität, Abfragen, Auswertungen, Modellpflege und nachvollziehbare Entscheidungen nicht nur schneller, sondern auch besser erklärbar werden.

Google Cloud Dataflow gewinnt vor allem dann, wenn der Einsatz bewusst eng gestartet wird: ein klarer Zweck, ein überschaubarer Daten- oder Aufgabenraum und ein Review, das nicht erst nach Problemen entsteht.

Redaktionelle Einschätzung

Bei Google Cloud Dataflow zählt weniger der Demo-Eindruck als der Betrieb im Alltag: Wer pflegt die Eingaben, wer bewertet das Ergebnis, und wo bleibt die fachliche Kontrolle?

Google Cloud Dataflow sollte zuerst in einem begrenzten Datensatz mit klarer Quelle, definierter Fragestellung, Owner und Abnahme zeigen, ob es trägt. Erst wenn Datenqualität, Laufzeit, Wartbarkeit, Ergebnisstabilität und Akzeptanz der Auswertung dort stabiler wirken, lohnt sich ein größerer Rollout.

- Prüfpunkt für Google Cloud Dataflow: Vor dem Rollout sollten Datenqualität, Laufzeit, Wartbarkeit, Ergebnisstabilität und Akzeptanz der Auswertung mit einem kleinen Vorher-nachher-Vergleich belegt werden.

- Guter Start für Google Cloud Dataflow: Besser ist ein kleiner Produktivfall mit Owner, Abnahmekriterium und Nachbesprechung als ein langer Vergleich ohne echte Nutzung.

- Risiko bei Google Cloud Dataflow: Der Einsatz kippt in Zusatzarbeit, wenn Datenquellen, Begriffe, Zugriffe und Verantwortlichkeiten unklar bleiben.

Hauptfunktionen

Unified Batch- und Streaming-Verarbeitung: Unterstützung für beide Verarbeitungsarten in einer einzigen Pipeline.

Apache Beam SDK-Unterstützung: Entwicklung von Pipelines mit bekannten Programmiersprachen wie Java und Python.

Automatische Skalierung: Dynamisches Anpassen der Ressourcen je nach Datenvolumen und Verarbeitungslast.

Integrierte Fehlerbehandlung: Verlässliche Datenverarbeitung mit automatischem Wiederholungsmechanismus bei Fehlern.

Nahtlose Integration in Google Cloud: Verbindung mit BigQuery, Cloud Storage, Pub/Sub und weiteren Google-Diensten.

Visualisierung und Monitoring: Echtzeitüberwachung der Pipelines über die Google Cloud Console.

Flexible Fenster- und Trigger-Mechanismen: Feinsteuerung der Datenaggregation und Verarbeitung in Streaming-Anwendungen.

Sicherheitsfunktionen: Unterstützung von IAM-Rollen und Verschlüsselung während der Datenverarbeitung.

Praxislauf mit Google Cloud Dataflow: Das Tool sollte mit einem begrenzten Datensatz mit klarer Quelle, definierter Fragestellung, Owner und Abnahme getestet werden, damit Stärken und Grenzen nicht nur theoretisch sichtbar sind.

Qualitätssicherung in Google Cloud Dataflow: Das Team braucht eine einfache Methode, um Datenqualität, Laufzeit, Wartbarkeit, Ergebnisstabilität und Akzeptanz der Auswertung nach dem Einsatz zu prüfen.

Übergabe mit Google Cloud Dataflow: Ergebnisse, offene Punkte und Entscheidungen sollten so dokumentiert werden, dass andere Rollen später weiterarbeiten können.

Vorteile und Nachteile

Vorteile

Vollständig verwalteter Dienst, keine Infrastrukturverwaltung nötig.

Hohe Skalierbarkeit für große Datenmengen.

Unterstützung für komplexe Datenverarbeitungslogiken.

Integration in das Google Cloud-Ökosystem erleichtert Workflows.

Echtzeit-Datenverarbeitung mit niedriger Latenz.

Flexibles Preismodell basierend auf tatsächlicher Nutzung.

Unterstützt mehrere Programmiersprachen.

Google Cloud Dataflow bringt mehr Ruhe in den Prozess, wenn Aufgaben, Review und Übergabe vor dem Start benannt werden.

Google Cloud Dataflow hilft vor allem dort, wo Datenqualität, Abfragen, Auswertungen, Modellpflege und nachvollziehbare Entscheidungen nachvollziehbar dokumentiert und nicht jedes Mal neu erklärt werden sollen.

Nachteile

Abhängigkeit von Google Cloud Plattform.

Komplexität bei der Einarbeitung in Apache Beam und Dataflow-spezifische Konzepte.

Kosten können bei sehr hohem Datenvolumen steigen.

Begrenzte Offline- oder On-Premises-Nutzung.

Teilweise eingeschränkte Kontrolle über die zugrundeliegende Infrastruktur.

Google Cloud Dataflow wird mühsam, wenn Datenquellen, Begriffe, Zugriffe und Verantwortlichkeiten unklar bleiben und das Team diese Lücken erst im Betrieb entdeckt.

Google Cloud Dataflow ist kein Selbstläufer: Ohne Owner und Review verliert das Team schnell den Überblick über Qualität und Grenzen.

Preise & Kosten

Google Cloud Dataflow verwendet ein nutzungsbasiertes Preismodell, das sich nach der Menge der verarbeiteten Daten und der genutzten Rechenressourcen richtet. Die Preise können je nach Region und spezifischem Anwendungsfall variieren. Es gibt keine festen monatlichen Gebühren, sondern Abrechnung erfolgt pro Sekunde CPU-Nutzung, Speicher und anderen Ressourcen. Für kleinere Projekte oder erste Tests bietet Google Cloud oft ein kostenloses Kontingent an.

Die Kosten von Google Cloud Dataflow bestehen nicht nur aus dem Tarif. In der Praxis zählen auch Infrastruktur, Betrieb, Monitoring, Schulung, Datenmodellpflege und Governance, weil genau dort die laufende Pflege und der echte Zeitaufwand entstehen.

👉 Zum Anbieter: https://cloud.google.com/products/dataflow

FAQ

1. Was ist der Unterschied zwischen Batch- und Streaming-Verarbeitung in Dataflow?

Batch-Verarbeitung verarbeitet Daten in festen Blöcken, während Streaming-Verarbeitung kontinuierlich eingehende Daten nahezu in Echtzeit verarbeitet.

2. Welche Programmiersprachen unterstützt Google Cloud Dataflow?

Dataflow unterstützt hauptsächlich Java und Python über das Apache Beam SDK.

3. Ist Google Cloud Dataflow für kleine Unternehmen geeignet?

Ja, insbesondere wenn sie skalierbare Datenverarbeitung benötigen. Die nutzungsbasierte Abrechnung hilft, Kosten flexibel zu halten.

4. Benötigt man spezielle Kenntnisse für die Nutzung von Dataflow?

Grundlegende Kenntnisse in Datenverarbeitung und Programmierung sind hilfreich, besonders im Umgang mit Apache Beam.

5. Wie sicher ist die Datenverarbeitung in Dataflow?

Dataflow nutzt Google Cloud-Sicherheitsmechanismen wie IAM-Rollen und Verschlüsselung, um Daten während der Verarbeitung zu schützen.

6. Kann Dataflow mit anderen Google Cloud-Diensten kombiniert werden?

Ja, Dataflow ist für die Integration mit Diensten wie BigQuery, Pub/Sub und Cloud Storage optimiert.

7. Gibt es eine kostenlose Testversion von Google Cloud Dataflow?

Google Cloud bietet häufig ein kostenloses Kontingent zur Nutzung verschiedener Dienste, darunter auch Dataflow, an.

8. Wie erfolgt das Monitoring von Dataflow-Pipelines?

Über die Google Cloud Console können Nutzer Pipelines in Echtzeit überwachen und Fehler diagnostizieren.

9. Wie sollte ein Team Google Cloud Dataflow testen? Google Cloud Dataflow sollte mit einem realen, begrenzten Anwendungsfall getestet werden: Ziel, Owner, Datenbasis, Review-Schritte und Erfolgskriterien vorher festlegen und danach Aufwand sowie Ergebnisqualität vergleichen.

10. Wann ist Google Cloud Dataflow eher keine gute Wahl? Google Cloud Dataflow passt schlecht, wenn Datenquellen, Begriffe, Zugriffe und Verantwortlichkeiten unklar bleiben oder wenn niemand Zeit für Einrichtung, Prüfung und laufende Pflege reserviert. Dann wird aus dem Werkzeug schnell ein zusätzlicher Pflegefall.