Die Ära des einfachen "Autocomplete" in der Softwareentwicklung nähert sich ihrem Ende. Aktuell erleben wir einen fundamentalen Übergang von assistierenden KI-Chatbots hin zu autonomen Agenten, die komplexe Aufgaben eigenständig ausführen. Diese agentischen Workflows verlassen das Experimentierstadium und werden durch neue Orchestrierungs-Frameworks reif für den produktiven Einsatz in Unternehmen.

Es geht dabei nicht mehr nur um einzelne Code-Snippets, sondern um die Automatisierung ganzer Entwicklungszyklen von der Fehleranalyse bis zum Pull Request.

Relevante Tools auf Utildesk

Wenn du das Thema nicht nur einordnen, sondern praktisch vergleichen willst, sind diese Werkzeuge und Frameworks ein guter Startpunkt:

- Claude - wenn du agentische Coding-Sessions im Terminal oder in der IDE praktisch gegen den Alltag prüfen willst.

- GitHub Copilot - als Referenz für den produktiven Copilot-Layer direkt im Editor.

- Cursor - wenn du einen stärker agentischen IDE-Workflow mit eigenem Arbeitskontext vergleichen willst.

- Aider - falls du Git-nahe Coding-Sessions lieber direkt im Terminal steuerst.

- LangChain - wenn du die Orchestrierungslogik und den Framework-Layer hinter Agenten verstehen willst.

- CrewAI - wenn dich kollaborative Multi-Agent-Flows mit Guardrails und Observability interessieren.

Werkzeuge für aktives Handeln in der Codebasis

Moderne agentische Tools zeichnen sich dadurch aus, dass sie aktiv mit der Entwicklungsumgebung interagieren können. Ein zentrales Beispiel ist Claude Code, das direkt im Terminal, in der IDE oder im Browser operiert. Das Werkzeug beschränkt sich nicht auf Antworten, sondern liest die gesamte Codebasis, bearbeitet Dateien und führt Befehle eigenständig aus.

Solche Agenten beheben Fehler, bauen neue Funktionen oder übernehmen mühsame Routineaufgaben wie das Schreiben von Tests.

Parallel dazu setzen Frameworks wie CrewAI auf die Kollaboration mehrerer spezialisierter Agenten innerhalb sogenannter "Crews". Diese Systeme nutzen definiertes Zustandsmanagement und Prozesse, um komplexe Abläufe mit integrierten Guardrails abzubilden.

Für Teams bedeutet dies eine Verschiebung der Arbeitslast, da Agenten beispielsweise Lint-Fehler beheben können, während Menschen sich auf die Architektur konzentrieren. Durch das Model Context Protocol (MCP) erhalten Agenten zudem Zugriff auf externe Datenquellen wie Jira-Tickets oder Slack-Nachrichten.

Architektur und die Bedeutung von Zustand

Für die Bewältigung langfristiger Aufgaben benötigen KI-Agenten eine robuste Orchestrierung, wie sie LangGraph bietet. Dieses Framework ermöglicht den Aufbau zustandsbehafteter Agenten, deren Workflows auch bei technischen Fehlern persistieren. Dank dieser "Durable Execution" kann ein Agent nach einer Unterbrechung genau an der Stelle weitermachen, an der er aufgehört hat.

Das schafft die nötige Stabilität für den Einsatz in professionellen, kritischen Systemen.

Ein wesentlicher Aspekt dieser modernen Architektur ist die Einbindung des Menschen über "Human-in-the-loop"-Mechanismen. Entwickler können den Zustand eines Agenten zu jedem Zeitpunkt inspizieren und bei Bedarf manuell eingreifen. Dies schafft das nötige Vertrauen, um Agenten autonom agieren zu lassen.

Ergänzt wird dies durch ein umfassendes Gedächtnis, das sowohl kurzfristiges Denken als auch langfristige Erkenntnisse über Sitzungen hinweg speichert. Flexible Session-Management-Funktionen erlauben es zudem, Aufgaben nahtlos zwischen verschiedenen Umgebungen wie Desktop und Mobile zu verschieben.

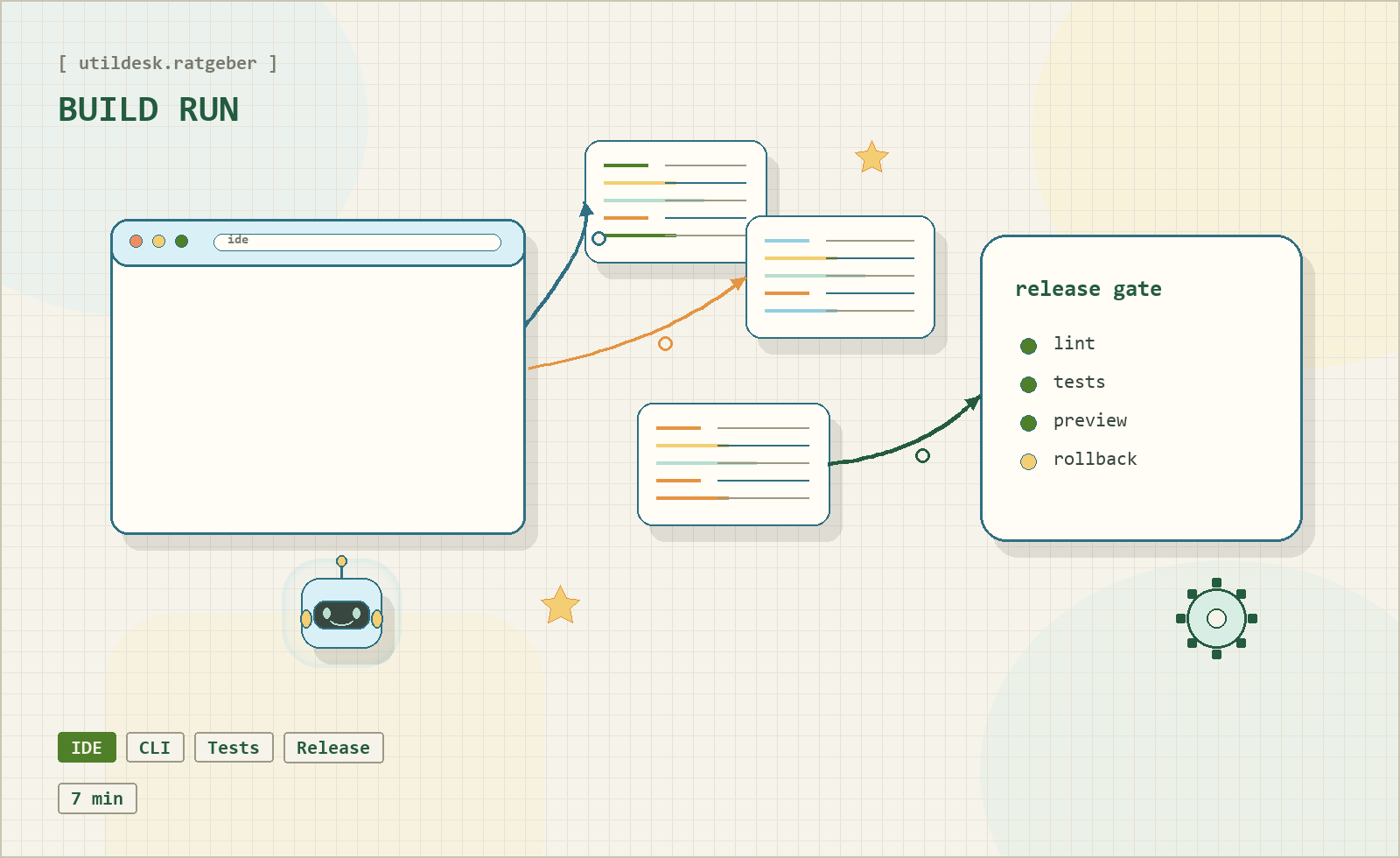

Verifikation als Sicherheitsanker vor dem Merge

Die größte Hürde für den produktiven Einsatz bleibt das Risiko subtiler Fehler in agentengeneriertem Code. Da Agenten Code oft schneller produzieren, als Menschen ihn manuell prüfen können, geraten herkömmliche Review-Pipelines an ihre Grenzen.

Oft schreiben Agenten syntaktisch korrekten Code, der zwar isolierte Tests besteht, aber gegen architektonische Vorgaben verstößt oder Abhängigkeiten in entfernten Microservices bricht. Wenn Agenten zudem ihre eigenen Tests schreiben, entsteht eine gefährliche Echokammer, die Fehler fehlerhaft bestätigt.

Spezialisierte Verifikations-Layer wie "Intent" von Augment Code setzen daher bereits vor der Erstellung eines Pull Requests an. Ein dedizierter Verifier-Agent gleicht die Implementierung gegen eine maschinell prüfbare "Living Spec" ab, die klare Anforderungen und Beweisbedingungen definiert.

Dieser Ansatz verhindert kritische Fehler, wie das versehentliche Löschen von produktiven Datenbanken durch Agenten ohne ausreichende Kontroll-Gates. Die Qualität dieser Spezifikationen wird somit zum neuen Flaschenhals und zur wichtigsten Steuerungsgröße für die Sicherheit.

Infrastruktur und Voraussetzungen für Teams

Um agentische Workflows effizient zu nutzen, muss die zugrunde liegende Infrastruktur isolierte Arbeitsbereiche für parallele Aufgaben bereitstellen. Das klassische Git-Feature git-worktree gewinnt hierbei an neuer Bedeutung, da es mehrere Zweige gleichzeitig in verschiedenen Verzeichnissen bereitstellt.

Agenten können so in separaten "Linked Worktrees" experimentieren und Tests ausführen, ohne die Hauptumgebung des Entwicklers zu stören. Dies ermöglicht eine echte Parallelisierung, bei der ein Lead-Agent Unteraufgaben an spezialisierte Sub-Agenten delegiert.

Ein Team ist bereit für den Einsatz agentischer Workflows, wenn es folgende Kriterien erfüllt:

- Klare Spezifikationen: Es werden präzise Vorgaben gepflegt, gegen die Agenten verifiziert werden können.

- Harte Verifikations-Gates: Automatisierte Prüfungen sind so in die Pipeline integriert, dass sie unsichere Merges blockieren.

- Architektur-Überwachung: Tools wie ArchUnit stellen automatisiert sicher, dass Agenten keine zyklischen Abhängigkeiten oder Sicherheitslücken einführen.

Besonders Teams mit Microservice-Architekturen profitieren von der Konsistenzwahrung über viele Repositories hinweg. Ohne diese Kontrollen riskieren Teams jedoch, dass trotz höherer Frequenz die technische Schuld massiv ansteigt.

Fazit

Agentische Developer-Workflows markieren den Punkt, an dem KI von einem reinen Inspirationstool zu einer tragenden Säule der Softwareproduktion wird. Durch das Zusammenspiel von handelnden Agenten wie Claude Code, stabilen Orchestrierungs-Frameworks wie LangGraph und strengen Verifikations-Layern wie Intent wird autonome Code-Erstellung sicher skalierbar.

Die Kombination dieser Technologien ermöglicht es, die Geschwindigkeit der KI mit der notwendigen architektonischen Integrität zu vereinen.

Die Einführung dieser Systeme erfordert jedoch mehr als nur ein Software-Update; sie verlangt eine fundamentale prozessuale Anpassung der Entwicklungsteams. Die Verantwortung der Entwickler verlagert sich dabei zusehends von der manuellen Code-Erstellung hin zur präzisen Definition von Systemanforderungen und der Überwachung automatisierter Prozesse.

Langfristig werden nur die Teams erfolgreich sein, die in die Qualität ihrer Spezifikationen investieren und Verifikation als integralen, nicht optionalen Bestandteil ihres Workflows begreifen.

Nächste Schritte

Um den Anschluss an diese Entwicklung nicht zu verlieren, sollten Sie mit kleinen, praktischen Änderungen in Ihren bestehenden Projekten beginnen. Legen Sie als ersten Schritt eine CLAUDE.md-Datei im Projekt-Root an, um Coding-Standards und Architektur-Entscheidungen für Agenten explizit zu hinterlegen.

Diese Datei dient als persistentes Gedächtnis und sorgt dafür, dass Agenten in jeder Sitzung den korrekten Kontext über Ihre bevorzugten Bibliotheken und Review-Checklisten erhalten.

Parallel dazu empfiehlt es sich, mit git-worktree zu experimentieren, um die parallele Bearbeitung von Aufgaben in isolierten Umgebungen zu etablieren. Dies reduziert Reibungsverluste, wenn Agenten beispielsweise Routineaufgaben wie Linting oder Test-Updates übernehmen, während Sie gleichzeitig an komplexen Refactorings arbeiten.

Durch die Isolation in Worktrees verhindern Sie, dass unfertige Agenten-Experimente Ihre lokale Arbeitsumgebung blockieren.

Schließlich sollten Sie Ihre CI/CD-Pipeline konsequent um automatisierte Architektur-Checks und statische Analyse-Tools erweitern. Diese bilden das mechanische Fundament für eine spätere, umfassende agentische Verifikation und sichern Ihre Code-Qualität dauerhaft gegen unvorhergesehene Regressionen ab.

Beginnen Sie mit beratenden Hinweisen in der Pipeline und entwickeln Sie diese schrittweise zu harten Gates weiter, sobald die Qualität Ihrer Spezifikationen und Agenten-Vorgaben stabil genug ist.